120点以上のプレビルド型 Connector

ビジネス全体をより迅速に接続

120点以上のプレビルド型 Connector を使用して、あらゆるデータソースやシンクのデータサイロを打ち破ります。

Connector 1点あたりの開発期間を3~6か月短縮

Save 3-6 months of development per connector

レガシーシステムとクラウドシステムを連携させて技術スタックを近代化

Modernize your tech stack by bridging legacy & cloud systems

完全マネージド型 Connectors で運用負担、リスク、TCO (総消費コスト) を削減

Reduce ops burden, risk, & TCO with fully managed connectors

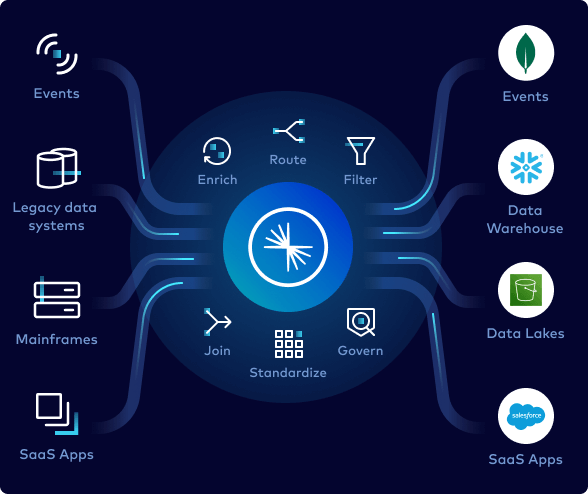

Kafka Connect は Apache Kafka® との間でデータを統合する��ためのオープンスタンダードです。

Confluent は、120点以上のプレビルド型 Connector という市場最大のポートフォリオを提供することで、Kafka Connect をさらに進化させています。これらはすべて、エンタープライズグレードのセキュリティ、信頼性、サポートを備え、リスクと運用上の負担を排除します。

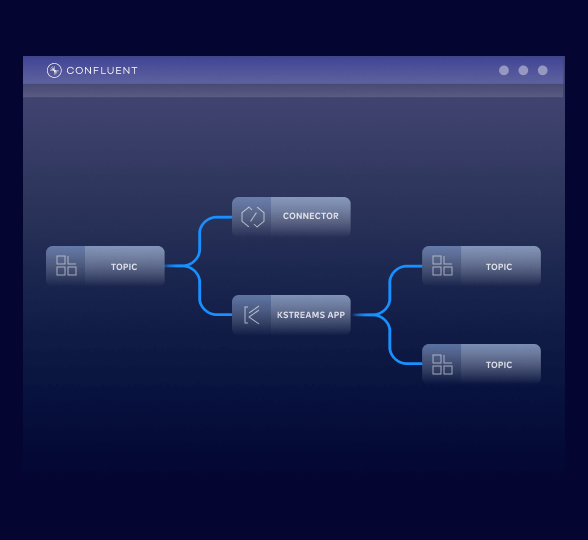

コードなしでデータを統合

__チームを汎用的な統合コードの作成や Connectors の管理から解放します。__Connectors を定義し、その送信元と受信先を特定し、プライベートネットワーク内で設定ファイル、UI、または API を通じてストリーミングを開始するだけで作業は終了です。

Confluent は120種類以上の統合を提供しています。

プレビルド型 Connectors

各Connectorsの設計、構築、テストに必要な3~6か月のエンジニアリング期間を回避

完全マネージド型の Connector

運用オーバーヘッドなしで数分で起動し、総所有コストを削減

Custom Connectors

カスタムアプリ用の独自コネクターを導入し、Connect インフラストラクチャの管理は当社に一任

エンタープライズグレードのセキュリティとサポート

プライベートネットワーク、99.99%のアップタイム SLA、RBAC、専門家のサポートにより、ミッションクリティカルなワークロードを強化

技術スタックを近代化

コネクターを使用してデータストリーミングパイプラインを簡単に構築し、レガシーシステムと最新のクラウドテクノロジーをつなぎます。

Confluent の Connectors には以下が含まれます。

データベース

CDC コネクターでレガシーデータベースからクラウドネイティブなデータベースへの移行を加速し、リスクを軽減

データウェアハウス

データチームが最新��の情報を扱うことができるよう、リアルタイムのデータをクラウドデータウェアハウスにストリーミング

データレイク

データソースとシンクを分離することでデータレイクにデータを追加し、データアーキテクチャを簡素化

SaaS アプリ

すべての SaaS アプリを接続し、ビジネスのあらゆる部分からのデータを全員で使用できるように

2日目のオペレーションを簡素化

__Confluent はお客様の環境全体にわたって広範な制御と可視性を提供します。__以下の方法でワークフローを効率化できます。

AWS IAM AssumeRole

一時的な認証情報を用いて、組織全体の AWS リソースへのアクセスを容易かつ安全に管理

即時の設定検証

フィールド入力に対するフィードバックとエラーアラートを受け取り、Connectors を正常に起動

クライアント側のフィールドレベル暗号化

Connectors 内でレコードの暗号化および復号を可能にすることで、機密性の高いワークロードをサポート

カスタムシングルメッセージ変換

ストリーム処理の前に、ソースまたはシンクコネクタ内でマスキングやフィルタリングなどの軽量なデータ変換を実行

ログとメトリクス監視

コンソールで Connectors のイベントを表示し、コンテキスト情報とエラーデバッグを実行

「強力で完全マネージド型の Connectors を使用して、Amazon S3 などの宛先にデータを簡単にストリーミングし、リアルタイムのイベントロギングをスケーラブルかつ効率的にします。Confluent には、最終的な方法を決定する前に迅速にプロトタイプを作成できる、豊富な事前構築済み Connectors のライブラリがあります。」

EVO Banco は、事実上無制限のコネクタを介して幅広いデータソースにアクセスすることができました。構成は簡単で、必要なデータソースの種類を指定し、接続の詳細を入力するだけです。このようにして、同社は即座にシームレスにデータを送り始めることができました。

「Confluent の完全マネージド型 Connectors により、より迅速にイノベーションを進めることができます。実際に、一般的なデータソースへのカスタム統合ではなく、新しい機能の構築に開発リソースを投資できます。」

新規開発者は、最初の30日間で$400分のクレジットを獲得できます — 営業担当者とのやり取りは不要です。

Confluent は、必要なすべてを提供します。

- 構築:Java や Python などのクライアントライブラリ、サンプルコード、120以上の事前構築済みコネクタ、Visual Studio Code 拡張機能を活用して開発可能です。

- 学習:オンデマンドコース、認定資格、世界中のエキスパートコミュニティから学べます。

- 運用:CLI、Terraform や Pulumi 向け IaC サポート、OpenTelemetry による可観測性を活用できます。

以下のクラウドマーケットプレイスアカウントでサイ�ンアップするか、当社で直接サインアップできます。

Confluent Cloud

完全マネージド型、クラウドネイティブの Apache Kafka® サービス

Confluent Connectors | FAQS

Can I modernize legacy systems with Confluent connectors?

Confluent offers a portfolio of more than 120 pre-built, enterprise grade connectors that make it easy for you to connect external systems to your Kafka deployments. By taking advantage of these connectors, you no longer have to write, test, and maintain integration code just to get your data into and out of Kafka topics.

That means you can easily modernize legacy systems with Confluent—easily connect your legacy databases, mainframes, and messaging systems to cloud data services and platforms with Confluent as your intermediary data access layer.

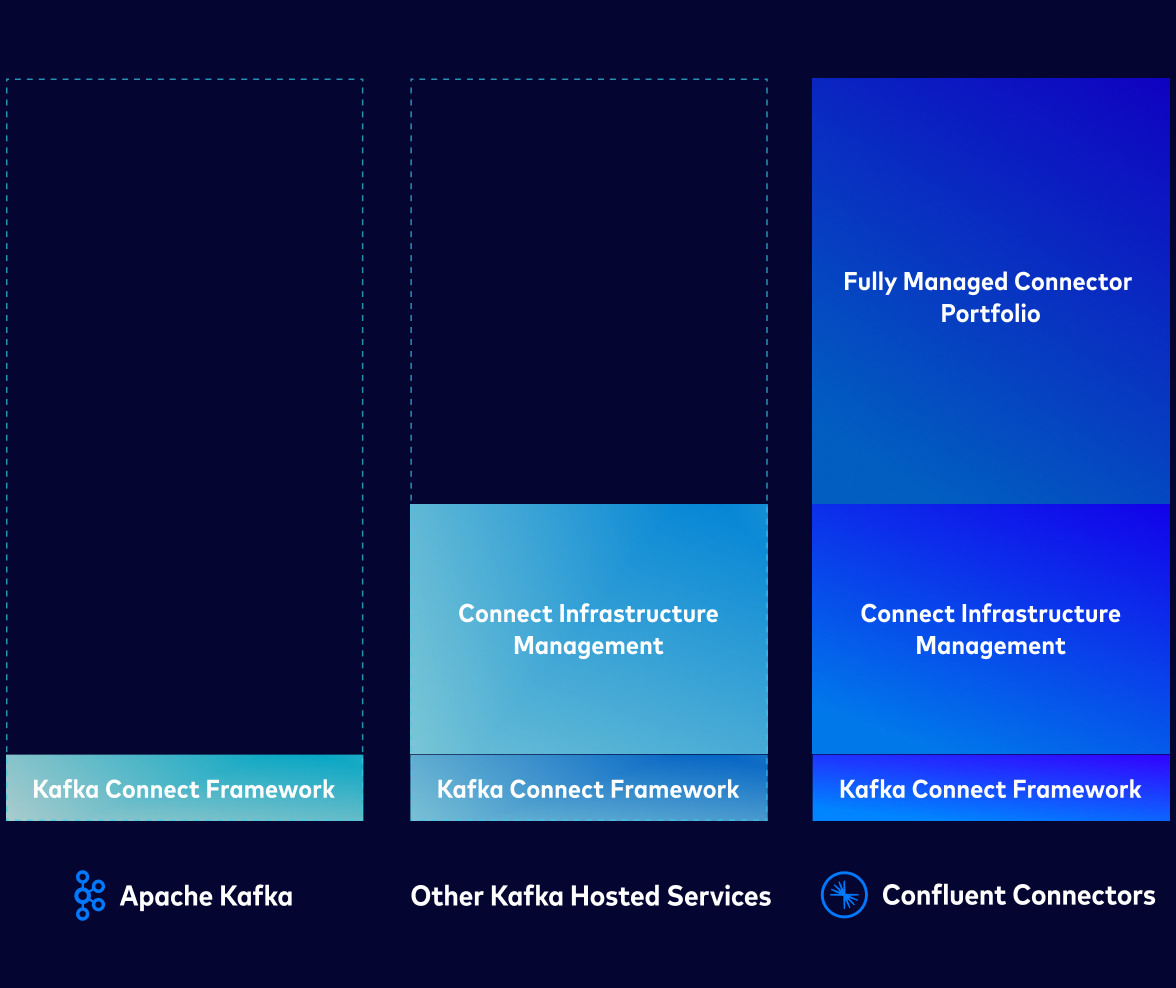

What makes Confluent-managed connectors different from open source Kafka Connect?

Confluent offers 80+ fully managed connectors, which means that you don’t have to manage connector plugins or their underlying infrastructure and can offload provisioning, upgrades, and patching.

Confluent-managed connectors eliminate integration overhead for your Kafka deployments and come with a 99.99% uptime SLA for production workloads. As a result, using these connectors frees your engineering teams from the burden of managing integration code and infrastructure. Instead, your teams can focus on building applications and unlocking the value of your data.

Other key operational benefits include:

- Seamless Upgrades: Features like plugin versioning for custom connectors allow for smooth upgrades without losing offsets or disrupting service.

- Improved Troubleshooting: Non-admin roles can now access connector logs, empowering them to manage and diagnose their own connectors without escalating to an administrator.

- Less Maintenance: Confluent manages all the underlying infrastructure so your team doesn't have to worry about provisioning, patching, or scaling the Connect environment.

How do Confluent connectors help reduce total cost of ownership (TCO)?

Confluent's fully managed connectors help lower your Kafka TCO by eliminating the costs associated with building and maintaining the integration code in connector plugins and from self-managing a Kafka Connect environment.

Key savings come from:

- Cost-Efficient Infrastructure Scaling: Elastic scaling for all Confluent connectors and autoscaling with fully managed connectors enables you to scale and consume compute resources more efficiently.

- Reduced Operational Burden: With fully managed connectors, you save on the engineering time and resources needed for maintenance, troubleshooting, and upgrades. High-availability reduces the business impact of unplanned pipeline downtime.

- Increased Developer Productivity: With simplified, secure streaming integration, your developer teams spend less time blocked by data access issues and can dedicate more resources to building real-time applications and event-driven systems across the organization. And using pre-built connectors can help cut 3-6 months from your production timelines.

How does Confluent’s price guarantee apply to connectors?

Confluent will beat or match the price of Kafka services from your hyperscaler, allowing you to save money on your streaming workloads—including when it comes to your Connect tasks.

Visit the Confluent Cost Estimator to see how much you can save as you scale seamlessly and cost-effectively with Confluent. Explore the volume-based discounts that you can access for Connect tasks with annual commitments for Confluent Cloud.

What security and compliance features are available for sensitive data?

Confluent connectors are built with enterprise-grade features for security, reliability, and developer productivity including secure private networking configurations, built in single message transforms (SMTs), and more.

Confluent helps ensure that the streaming data pipelines you build are secure and compliance, with purpose-built features for handling sensitive data:

- Granular Access Control: Enhanced role-based access control (RBAC) allows you to grant users the specific permissions they need to manage connectors without giving them full admin rights.

- Secure Networking: You can connect to data systems in private networks using features like DNS Forwarding and Egress PrivateLink, restricting traffic from the public internet.

- Data Masking: You can use single-message transforms (SMTs) to perform lightweight transformations on connector workloads, including masking sensitive data field within a data stream.

- Data Encryption: Specific connectors, like the one for Oracle XStream, support client-side field level encryption (CSFLE) to ensure data remains secure continuously.

- Advanced Authentication: Many connectors support modern, secure authentication methods like AWS IAM AssumeRole, which removes the need for long-lived access keys. Others support protocols like OAuth2 and SSO integration.

How quickly can I launch a connector in Confluent Cloud?

You can launch fully managed connectors in seconds with no-code provisioning and real-time configuration checks, Simply find the fully managed connector you need on Confluent Cloud and hit launch or access them directly from your Confluent Cloud account.

Self-managed connectors require more initial setup to run alongside your cloud deployment. Search Confluent Hub to find self-managed Confluent, partner, and community-built connectors and then visit Docs to learn how to connect self-managed Kafka Connect to Confluent Cloud.

Do I need to browse the Connector Hub to get started?

While you don't need to browse Confluent Hub to get started, it is a great way to see all the options available for your self-managed and fully managed Kafka deployments. The Hub helps you discover what integrations are available via Confluent, as well as find open source and partner-verified connectors beyond the 120+ that we offer.

If you’re looking specifically for fully managed connectors to use on AWS, Microsoft Azure, or Google Cloud, you can log in to the Cloud Console and launch connectors in just a few clicks.

Can I bring my own custom connector to Confluent Cloud?

Yes, you can bring your custom and in-house built connectors to Confluent Cloud. The platform now supports plugin versioning for custom connectors, which allows you to upload a new version of your plugin and seamlessly direct active connectors to it, resuming from the last offset. This is managed through the new Custom Connect Plugin Management (CCPM) APIs.

How do Confluent connectors support real-time AI and analytics initiatives?

Confluent connectors are the foundational layer for real-time AI and analytics, as they feed live data streams from across your business into the platforms where this analysis occurs. Capture changes as they happen from databases like PostgreSQL and Oracle using Confluent’s CDC connectors.

Then, stream the real-time events needed for AI/ML models and analytics dashboards to understand and act on the state of the business. Combined with sink connectors for major analytics and data warehouse platforms—such as Snowflake and Amazon Redshift—this allows you to stream processed, enriched data directly into these systems for immediate use. This ability to build real-time pipelines is essential for unlocking new AI and analytics use cases.